Estariam os algoritmos aprendendo "a colocar lenha na fogueira"?

Quando aprendizado de máquina pode estar sendo usado para aumentar engajamento junto com discurso de ódio

Na minha época de ensino médio, lembro das pessoas que eram especialistas em “colocar lenha na fogueira”. Qualquer briga, elas conseguiam piorar a situação, “jogando gasolina na fogueira”.

Já sabemos que os bots do Facebook conseguem criar bolhas: basicamente, você é servido com conteúdo do seu interesse, somente. Nada de estresse cognitivo te forçando a ver postagens de quem discorda de você. A cada momento que interage, recebe mais postagens do mesmo teor. Isso seria alimentar com conteúdo de interesse, de certa forma, neutro emocionalmente.

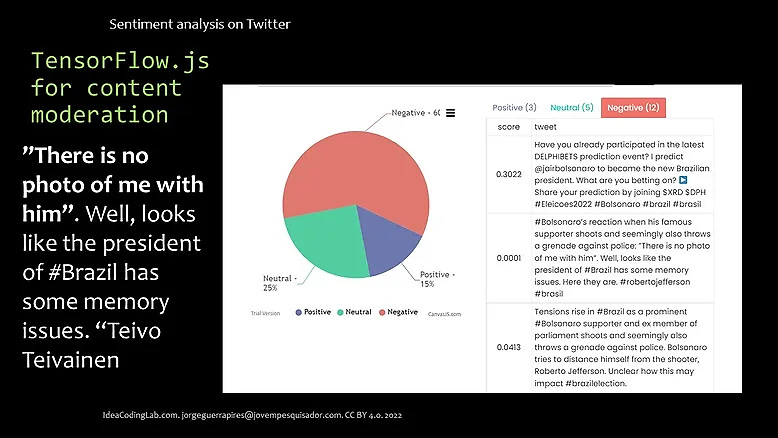

Não é novidade para mim que os algoritmos conseguem agora medir a neutralidade de comentários, eu mesmo fiz um simples para identificar ofensas.

Esse insight me veio a cabeça depois de notar, por algum tempo, que o primeiro comentário da postagem de Facebook dita o restante. Se o primeiro for negativo, chances são baixíssimas de que o restante vai ser melhor.

Estamos caminhando para discussões não produtivas.

Claro, isso poderia ser somente comportamento humano, que acaba se impregnando no algoritmo como o caso do Google Image, que mostra imagens de pessoas negras quando questionado sobre cabelo ruim. Contudo, dado o objetivo principal da rede de lucrar, inclusive com discurso de ódio, não me deixaria surpreso em saber que indiretamente ou diretamente, esse comportamento humano possa estar sendo usado para gerar engajamento.

Eu tenho minhas dúvidas de que nas redes as pessoas buscam conteúdo. Quando abre o Facebook, como exemplo, você vê na sua timeline algo servido. Uma vez que você gosta de conteúdos negativos, como exemplo, pessoas sendo linchadas, o algoritmo teoricamente poderia te servir com isso, aumentando o engajamento. Já temos a tecnologia, e motivações não faltam dado o interesse primários dessas plataformas.